文|王怡宁

编辑|邓咏仪

12月初,法国AI初创公司Mistral AI已正式结束其备受期待的A轮融资。据彭博社报道,公司已筹集了3.85亿欧元(约4.15亿美元),该公司的估值约为20亿美元。Mistral AI今天也开放了其商业平台。

12月8日,Mistral AI的官方Twitter发布了他们账号开通以来的第三条推文,没有热闹盛大的发布会,也没有让人眼前一亮的宣传视频,仅仅是一条普通到不能再普通的磁力链接,就打破了AI开发者圈的平静。

△图源:Twitter

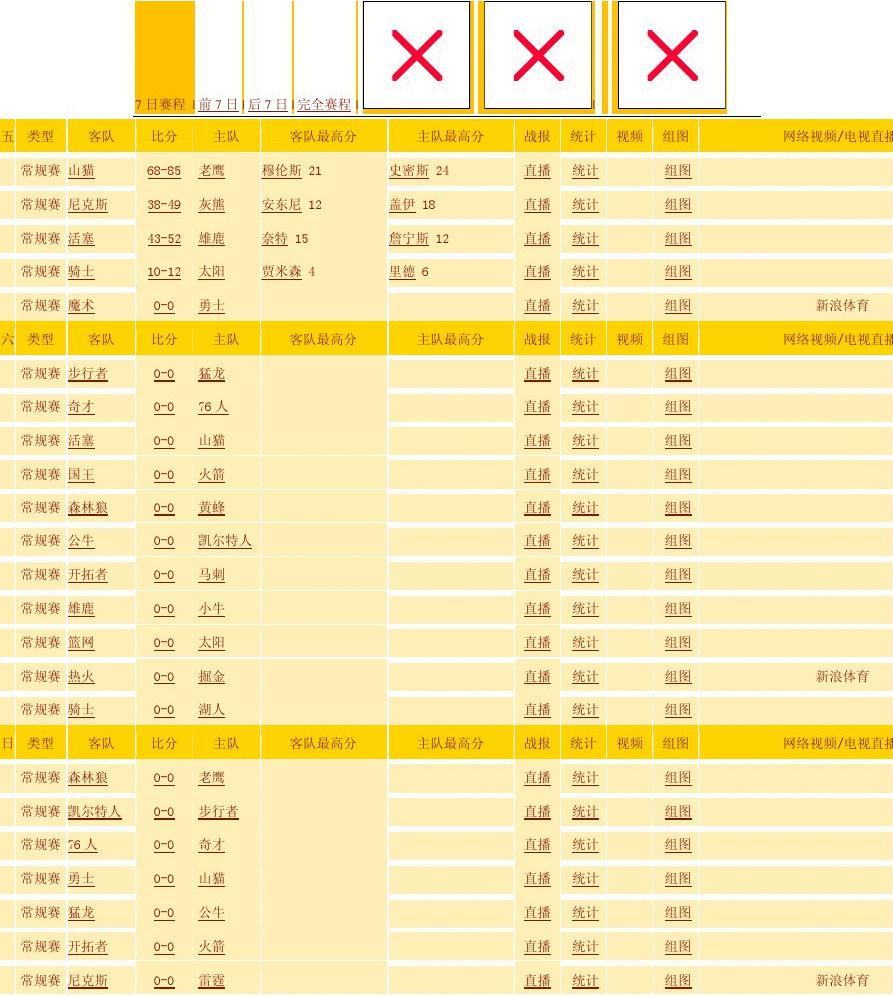

这条下载链接通向的正是近期震动AI圈的开源MoE模型——Mixtral8x7B。

从名字来看,Mixtral8x7B就揭示了其架构:由8个70亿参数组成的小模型组合,这也被称为MoE(Mixture of Experts,混合专家)架构——指把复杂任务分成一系列更小且更容易处理的子任务,每个子任务都由一个特定领域的“专家”负责处理。MoE架构让整体模型更多功能且强大。同样这也是GPT-4采用的架构。

从官方公布的数据来看,Mixtral8x7B在基准测试中的表现十分出色,跑分全面超越GPT-3.5,更在多个跑分上超过了Llama2 70B,并且推理速度还是后者的6倍。

△图源:Mistral AI

在生成同等质量的模型时,Mixtral8x7B的推理过程消耗的成本也明显低于Mistral AI,高能效优势显著。

△图源:Mistral AI

此外,Mixtral8x7B还支持英语、法语、意大利语、德语和西班牙语五种语言,具备自然的编码能力。

开源、跑分优秀、高效……这一系列的优势叠加起来,让Mixtral8x7B有了赶超Chat-GPT的势头,这确实足以让人感到兴奋。

一位开发者在Mistral MoE的基础上做了微调,发布了dolphin-2.5-mixtral-8x7模型。这是一个完全未经审查的开源模型,这意味着它不会受开发者的道德观影响,也不会回复“作为一个AI助手,我不能……”

△图源:Twitter

而随着Mixtral8x7B一起走入大众视野的,还有它的开发者—来自法国的大模型公司Mistral AI,从名不见经传到一举成名,他们仅仅用了半年。

彭博社报道,公司已筹集了3.85亿欧元(约4.15亿美元),该公司的估值约为20亿美元。

而仅仅在6个月前,Mistral AI才完成1.05亿欧元(约1.13亿美元)的天使轮融资——也是欧洲历史上最大的种子轮融资。Mistral AI仅仅用了7页PPT,就吸引了包括Redpoint、Index Ventures在内的一众欧洲老牌风投机构。事实上,这家颇受欧美两地明星投资机构青睐的AI独角兽公司,在今年5月才在法国巴黎正式成立。

尽管成立时间不长,Mistral AI的三人创始团队却相当有分量,在多模态、RAG方向上都有着丰富经验。公司CEO Arthur Mensch是前DeepMind研究科学家,主导了Chinchilla、Retro、Flamingo等重要论文的发表,而这三篇论文分别是20-22年间Google在LLM、RAG、多模态三个领域最重要的作品。

首席科学家Guillaume Lample,也是前Meta研究科学家,与CTO Timothee Lacroix,都来自Llama核心团队。目前,MistralAI的团队仅有22名员工,保持着小而美的风格。

△图源:Mistral AI

在大语言模型当道的今天,Mistral AI却反其道而行之,从成立之初就专注于研发「小模型」。联合创始人兼CEO Arthur在与硅谷投资人Sarah Guo和Elad Gil的专访中提到,让模型变小一定会有助于Agents的开发和应用,小模型能够有效降低使用成本,也能在更多设备上运行,从而让更多有意思的应用有机会被构建。

Mistral AI近期发布的聊天模型正是对这一理念的实践。

近期,Mistral AI刚刚发布了开放平台La plateforme,并提供了mistral-tiny、mistral-small和mistral-medium三个基于指令生成文本的聊天模型,以及一个嵌入模型。

其中,最受市场关注的还是目前仍在测试阶段的“中杯”模型Mistral-medium。作为Mistral AI推出的最强开源模型,Mistral-medium在MT-Bench得分高达8.6,在主流测评中各项指标已优于GPT-3.5。

△图源:Mistral AI

Mistral AI另一个特别之处在于,对开源路线的坚定选择。

事实上,在2020年前,大部分大模型的研究成果都是共享和透明的,直到一些公司开始加速商业化,闭源模型才越来越广泛被使用。我们所熟知的OpenAI,最早就是作为一家开源的非盈利性组织创办的,而后才转为闭源公司,这也是曾经的投资者马斯克对其相当不满的点。

如今,除了Meta的LLaMA系列以外,目前大部分头部大模型厂商,如OpenAI、Google和微软都选择了闭源,但开源模型还是以能够快速迭代、可定制性的特点受到欢迎。这也是Mistral被称为“欧洲版OpenAI”的原因,在大公司纷纷闭源之际,也有人将Mistral AI称为开源路线的希望。

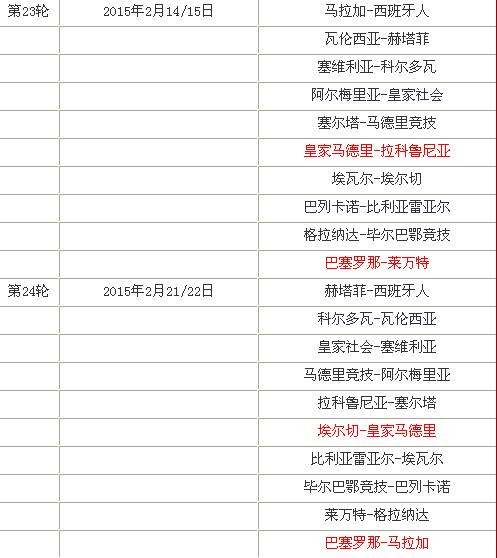

有趣的是,近日一张由ARK Invest团队制作的趋势图预测了2024年开源社区与专有模型在生成式AI上的发展。据其预测,开源模型的性能在不断提升,与专有模型之间的差距也将越来越小。对此,Meta首席AI科学家、图灵奖获得者Yann LeCun也转发表示:

开源人工智能模型正走在超越专有模型的路上。

△图源:Twitter

目前,Mixtral8×7B已经在不少开源模型平台上线,而开源究竟能否赶超闭源,仍需时间验证。

欢迎交流

网友评论

最新评论